Ihr Team wächst. Nach und nach kommen neue Gesichter hinzu. Doch irgendwo zwischen der Aufregung der Einarbeitungsphase und der Realität des Arbeitsalltags rutscht das Erstellen eines professionellen Porträts still und leise ganz nach unten auf der Prioritätenliste aller Beteiligten.

Wenn Sie Marketingleiter oder CTO in einem wachsenden Tech-Unternehmen sind, wissen Sie genau, wie das abläuft. Die Leute sind beschäftigt, Fotostudios sind teuer, und das Ergebnis ist eine „Über uns“-Seite, die ihre eigene Geschichte erzählt: ein Sammelsurium aus professionellen Porträts aus vergangenen Jahren, LinkedIn-Ausschnitten aus verschiedenen Epochen und dem einen oder anderen Konferenzfoto, das „damals gut genug“ war. Das ist nicht die Schuld von irgendjemandem. Es ist einfach die Kluft zwischen der Geschwindigkeit, mit der Teams wachsen, und der Langsamkeit, mit der die Logistik professioneller Fotografie mithalten kann.

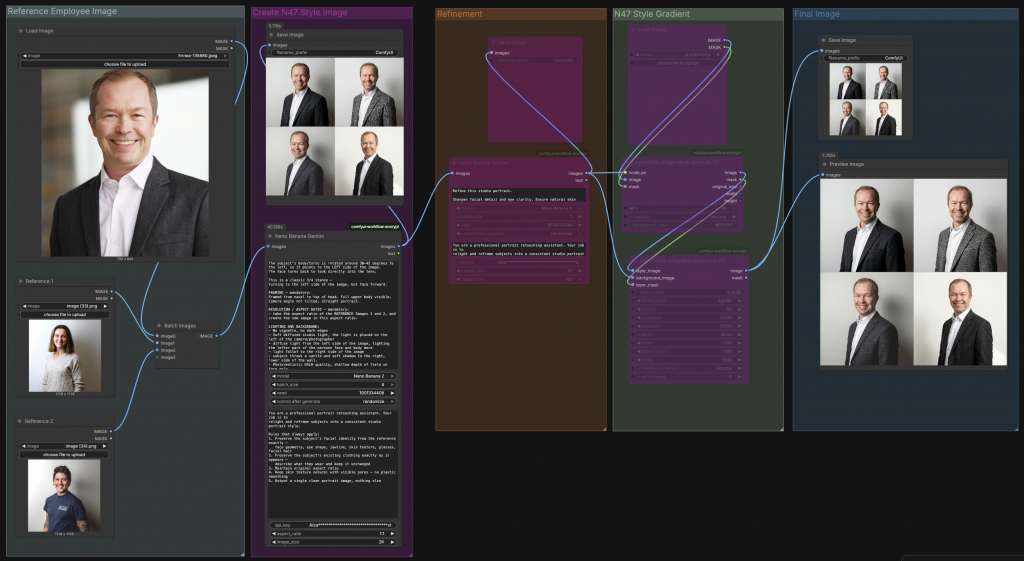

Bei N47 haben wir versucht, dieses Problem selbst zu lösen – mithilfe von KI. Dies ist die Geschichte, wie wir eine ComfyUI-Pipeline unter Verwendung von Googles Nano Banana 2-Modell aufgebaut haben, um jedes beliebige Schnappschussfoto eines Mitarbeiters in ein einheitliches, professionelles Studio-Porträt zu verwandeln. Und was noch wichtiger ist: die lehrreichen Erfahrungen, die wir dabei gemacht haben.

Der wiederkehrende Albtraum

Wenn ein Unternehmen wächst, löst die Aufnahme eines neuen Mitarbeiters für die Website eine Kette von Ereignissen aus, die Zeit, Energie und Geduld kosten:

Die Koordination: Sie müssen einen Zeitpunkt finden, an dem der Fotograf, der neue Mitarbeiter und ein geeigneter Studiobereich gleichzeitig verfügbar sind. In einem Remote-First- oder Hybrid-Team ist dies nahezu unmöglich.

Die E-Mail-Flut: Der Hin- und Her-Austausch zwischen Marketing, dem Mitarbeiter und demjenigen, der die Terminplanung verwaltet, führt zu einer überraschend langen Kette von Nachrichten für eine Aufgabe, die eigentlich einfach sein sollte. Alle haben gute Absichten, aber die Kalender sind voll und Prioritäten konkurrieren miteinander.

Die Photoshop-Falle: Selbst mit den besten Absichten sieht ein Foto, das im Homeoffice, in einem belebten Café oder bei gemischter Innenbeleuchtung aufgenommen wurde, natürlich anders aus als eine Studioaufnahme. Der Marketingleiter muss dann diese Unterschiede ausgleichen und verbringt Stunden damit, den Unterschied manuell mit Bearbeitungsprogrammen zu überbrücken.

Die Revision-Schleife: Trotz aller Bemühungen ist das Ergebnis meist eher „akzeptabel“ als hervorragend. Und einige Monate später beginnt derselbe Prozess für den nächsten neuen Mitarbeiter.

Dies ist nicht nur ein Kostenfaktor. Es hält talentierte Marketingfachleute in einem Hamsterrad aus sich wiederholenden, wenig Wert schaffenden Aufgaben gefangen. Das ist Zeit, die direkt der Strategie, den Kampagnen und dem eigentlichen Markenaufbau entzogen wird.

In einer Welt, in der der erste Eindruck innerhalb von Millisekunden entsteht, ist eine optisch uneinheitliche Teamseite ein echter Vertrauenskiller.

Die drei Testbilder mit unterschiedlicher Beleuchtung, Pose und Qualität.

Der Testfall: Einstieg in ComfyUI und Nano Banana 2

Für jedes Problem gibt es eine elegante Lösung. Unsere begann mit einer Frage: Was wäre, wenn ein Mitarbeiter uns ein beliebiges Foto – sogar ein Selfie – schicken könnte und unser System es automatisch in ein professionelles Studio-Porträt umwandeln würde, das zum Rest des Teams passt?

Die Antwort kam in Form von ComfyUI, einem visuell orientierten Workflow-Tool auf Node-Basis, kombiniert mit Nano Banana 2 – Googles Gemini 3.1 Flash-Image-Modell. Im Gegensatz zu einfachen KI-Fotofiltern schafft diese Kombination eine wiederholbare, steuerbare Pipeline, die sich wie ein professioneller Fotograf mit einer konsistenten Studioausstattung verhält.

Das Prinzip ist einfach: Man lädt ein Referenzfoto des Gesichts eines Mitarbeiters hoch und fügt ein oder zwei Beispiele für den gewünschten Studiostil hinzu. Dann weist man die KI an, ein neues Porträt zu erstellen, wobei die Identität der Person erhalten bleibt, aber die professionelle Beleuchtung, der Hintergrund und der Bildausschnitt der Stilvorlagen übernommen werden.

So die Theorie. In der Praxis sah es deutlich interessanter aus.

Technische Herausforderungen

Eine transparente Darstellung des Prozesses muss auch die Misserfolge einbeziehen, nicht nur die Erfolge. Hier ist, worauf wir stiessen und wie wir jedes einzelne Problem gelöst haben.

1. Das Problem mit der Prompt-Formulierung

Unser erster Impuls war, Prompts wie „Lass die Person unverändert und verbessere den Hintergrund“ zu schreiben. Das klingt logisch, führte aber durchweg zu schlechten Ergebnissen. Das Modell interpretierte dies als minimale Bearbeitung und entfernte einfach den Hintergrund, sodass die Person vor einer grauen Fläche schwebte.

Der Durchbruch gelang, als wir die gesamte Aufgabe neu formulierten. Anstelle von „Bearbeite dieses Bild“ lautete die Eingabeaufforderung nun: „Erzeuge ein neues professionelles Porträt. Verwende Bild 1 nur für die Gesichtserkennung. Behandle die Bilder 2 und 3 als Zielszene.“ Diese eine Umstellung – von der Bearbeitung zur Generierung – führte zu deutlich besseren Ergebnissen. Das Modell benötigt die Erlaubnis, das Bild vollständig neu zu erstellen.

2. Das Dilemma der Richtungen

Eines der hartnäckigsten Probleme, auf die wir stiessen, war die Ausrichtung der Posen. Wir wollten, dass die Personen einheitlich positioniert waren: Körper gedreht, Gesicht zur Kamera gerichtet – einfach zu beschreiben. Überraschend schwer umzusetzen.

Bei unserem ersten Versuch verwendeten wir anatomische Beschreibungen: „Rechte Schulter zur Kamera, linke Schulter von der Kamera weg.“ Das half zwar, führte aber dennoch zu uneinheitlichen Ergebnissen, da das Modell die Körperausrichtung manchmal relativ zum Motiv und nicht relativ zum Bildausschnitt interpretierte.

Die Lösung, die schliesslich funktionierte, bestand darin, alles in Bezug auf den Bildraum zu beschreiben, also darauf, was auf der linken und rechten Seite des tatsächlichen Bildes zu sehen ist, nicht auf den Körper der Person. Die Anweisung, die für mehr Konsistenz sorgte, lautete:

„Der Körper und der Oberkörper des Motivs sind um 30–45 Grad nach links gedreht, sodass sie zur LINKEN Seite des Bildes zeigen. Das Gesicht ist nach vorne gedreht, um direkt in die Kamera zu blicken.“

Kombiniert mit einer passenden Anweisung zur Beleuchtung: „Studiobeleuchtung links von der Kamera platziert, die die linke Seite von Gesicht und Körper stärker ausleuchtet, mit einem sehr weichen Schattenverlauf nach rechts“. Dadurch wurde das Ergebnis weitaus vorhersehbarer. Die Beschreibung dessen, wie das Bild aussieht, anstatt dessen, was die Person tut, erwies sich als der Schlüssel.

3. Halluzinationen bei der Kleidung

Wenn das Input-Bild stark beschnitten ist und nur das Gesicht und den Kragen zeigt, muss die KI ableiten, wie der Rest der Person aussieht. Ohne Vorgaben erfindet sie etwas. In unserem Fall fügte sie Mitarbeitern, die legere Sweatshirts trugen, immer wieder Anzüge und Krawatten hinzu.

Die Lösung bestand darin, das Modell ausdrücklich anzuweisen, die Kleidung auf natürliche Weise nach unten zu verlängern, anstatt sie zu ersetzen. Wenn das Referenzbild nur wenig Kleidung zeigt, generiert das Modell nun den unteren Teil desselben Kleidungsstücks – konsistent, professionell und ohne kreativen Spielraum.

4. Lichtrichtung und Schatten

Die Beleuchtung litt unter denselben Problemen wie die Pose: „links“ war mal die linke Seite des Motivs und mal die des Betrachters. Schlimmer noch, die Schatten waren äusserst uneinheitlich – entweder fehlten sie gänzlich oder sahen aus wie „schlechtes Photoshop“, wodurch sich das Motiv vom Hintergrund losgelöst anfühlte.

Wir wechselten zu Begriffen aus dem Bildraum: „Das Hauptlicht fällt von der linken Seite des Bildausschnitts ein und wirft einen weichen Schatten nach rechts.“ Indem wir die Präsenz und Richtung des Schattens explizit definierten, zwangen wir das Modell dazu, das Motiv in der Szene zu verankern. Die Beschreibung des Ziels des Schattens erwies sich als wichtiger als die Beschreibung der Lichtquelle selbst.

Die Lösung: Entwickeln, verfeinern, vermarkten

Nach umfangreichen Tests mit mehrstufigen Pipelines und einstufigen Ansätzen haben wir uns für einen übersichtlichen dreistufigen Prozess entschieden – allerdings nicht für drei Stufen der KI-Generierung. Die Hauptarbeit wird in nur einem einzigen Schritt erledigt. Was folgt, sind die Verfeinerung und das Branding.

Schritt 1: Der Generator-Prompt

Ein einziger, gut strukturierter Prompt, der mit dem Foto des Mitarbeiters sowie zwei Referenzporträts zum Stil gefüttert wird, übernimmt die Kernarbeit. Die Eingabeaufforderung ist in vier klare Abschnitte unterteilt, von denen jeder eine bestimmte Aufgabe hat:

An erster Stelle steht die Idendität. Dem Modell wird ausdrücklich mitgeteilt, Bild 1 nur für das Gesicht der Person, ihren Hautton, ihre Haare, ihr Alter, ihren Bart und ihre Augenform zu verwenden und alles andere an diesem Foto zu ignorieren: den Hintergrund, die Beleuchtung und die Pose. Diese Trennung ist entscheidend. Ohne sie versucht das Modell, Elemente der ursprünglichen Szene beizubehalten, die man eigentlich ersetzen möchte.

Die Pose wird im Bildraum definiert, nicht im Körperraum. Der Oberkörper dreht sich um 30–45 Grad, sodass er zur linken Seite des Bildes zeigt, während das Gesicht wieder zur Kamera gedreht wird. Die Beschreibung, wie das endgültige Bild aussieht, anstatt was die Person tun soll, gibt dem Modell ein eindeutiges visuelles Ziel vor.

Der Bildausschnitt wird explizit vom Bauchnabel bis zum Scheitel festgelegt, um sicherzustellen, dass der gesamte Oberkörper sichtbar ist. Wenn das Referenzfoto stark beschnitten ist und die Kleidung unterhalb der Brust nicht zeigt, wird das Model angewiesen, das Kleidungsstück auf natürliche Weise nach unten zu verlängern, anstatt etwas Neues zu erfinden.

Beleuchtung und Hintergrund werden mit physikalischer Präzision beschrieben: Ein Studiolicht, das links von der Kamera platziert ist und die linke Seite des Gesichts und des Körpers beleuchtet, mit einem sanften Lichtabfall und einem dezenten, weichen Schatten auf der rechten Seite der Wand hinter der Person. Keine Vignettierung, keine dunklen Ränder, fotorealistische DSLR-Qualität mit geringer Schärfentiefe, die sich ausschliesslich auf das Gesicht beschränkt.

Schritt 2: Verfeinerung

Die Ausgabe von Schritt 1 wird in einen zweiten Nano-Banana-Knoten mit einer gezielten Verfeinerungsanweisung eingespeist. Bei diesem Durchlauf wird das Bild nicht von Grund auf neu generiert, sondern es werden die Gesichtsdetails geschärft, kleinere Artefakte korrigiert, die Konsistenz der Kleidung überprüft und sichergestellt, dass der Hintergrund sauber und gleichmässig ausgeleuchtet bleibt. Indem die Verfeinerung als separater Schritt behandelt wird, wird verhindert, dass sich die Generierungs- und Bereinigungsaufgaben im selben Befehl überschneiden, was zu Unvorhersehbarkeiten führen würde.

Schritt 3: Der blaue N47-Farbverlauf

Der letzte Schritt hat nichts mit der KI-Generierung zu tun. Sobald das Porträt bestätigt ist, wird der N47-Farbverlauf als Design-Ebene über das Bild gelegt – die einheitliche visuelle Signatur, die die Porträts aller Teammitglieder zu einer einzigen, wiedererkennbaren Markenidentität verbindet.

Das Ergebnis ist ein schlanker, vorhersehbarer und vollständig wiederholbarer Arbeitsablauf: ein Generierungsschritt, ein Verfeinerungsschritt, ein Branding-Schritt. Jede Phase hat eine klare Aufgabe, und keine überschneidet sich mit einer anderen.

Die wichtigsten Erkenntnisse

Für jedes Marketing- oder Technologieteam, das diesen Ansatz in Betracht zieht, sind dies die ehrlichen Erkenntnisse aus unserem Prozess:

Das Formulieren von Eingabeaufforderungen ist eine professionelle Fähigkeit. Vage Anweisungen führen zu vagen Ergebnissen. Der Unterschied zwischen „nach links drehen“ und „Oberkörper zur LINKEN Seite des Bildes gedreht“ ist der Unterschied zwischen einem konsistenten Ergebnis und einem 50:50-Glücksspiel bei jeder Generierung. Zu beschreiben, wie das endgültige Bild aussehen soll, anstatt was die Person tun soll, ist die gedankliche Umstellung, die alles verändert.

Die Qualität der Eingabe spielt nach wie vor eine Rolle. KI kann bei schlechter Beleuchtung und unruhigen Hintergründen fast Wunder vollbringen. Die besten Ergebnisse erzielt man jedoch mit einem klaren, frontal aufgenommenen Foto (oder mehreren Referenzbildern bei gleicher Beleuchtung) mit neutralem Gesichtsausdruck. Je weniger das Modell über das Gesicht raten muss, desto authentischer ist das endgültige Porträt.

Es gibt kein Feld für negative Eingaben. Im Gegensatz zu herkömmlichen Diffusionsmodellen erfordert Nano Banana 2 ausschliesslich positive Formulierungen. Anstelle von „kein Anzug“ schreibt man „ein schwarzes Sweatshirt mit Rundhalsausschnitt“. Anstelle von „kein dunkler Hintergrund“ schreibt man „eine schlichte, gleichmässig beleuchtete hellgraue Wand“. Jede Einschränkung muss als etwas ausgedrückt werden, das man will, nicht als etwas, das man nicht will.

KI liefert selten beim ersten Versuch das perfekte Ergebnis. Nutzen Sie die Kraft der Wiederholung und führen Sie denselben Arbeitsablauf mehrmals durch, um der dem Modell innewohnenden Zufälligkeit Rechnung zu tragen. Beurteilen Sie eine Eingabeaufforderung niemals anhand eines einzigen Bildes, sondern führen Sie sie mindestens 3–5 Mal durch, um das gesamte Spektrum an Interpretationen zu sehen, bevor Sie sich entscheiden, Ihre Formulierung anzupassen.

Wenn das erste Ergebnis zu 80 % Ihren Vorstellungen entspricht, schreiben Sie die Eingabe nicht um. Führen Sie sie erneut aus. Erst wenn die KI nach drei Versuchen immer noch am Ziel vorbeischiesst, sollten Sie Ihre beschreibende Sprache anpassen.

Kennen Sie die Grenzen des Mediums. KI-generierte Porträts eignen sich hervorragend für Teamseiten auf Websites, LinkedIn-Profile und Social-Media-Beiträge – also Formate, bei denen Bilder auf Bildschirmen in relativ kleiner Grösse betrachtet werden. Bei grossformatigen Druckanwendungen wie Ausstellungsbannern, gedruckten Broschüren, Messematerialien oder Plakatwerbung kann die Ausgabequalität jedoch zu wünschen übrig lassen. Die KI-Generierung führt zu subtilen Texturartefakten und unscharfen Details, die bei einer Breite von 200 px auf einem Handybildschirm unsichtbar sind, aber beim Druck in Originalgrösse auffallen. Für alles, was physisch grösser als A4 gedruckt wird, empfehlen wir entweder eine Ergänzung durch ein professionelles Fotoshooting oder die Durchführung zusätzlicher Hochskalierungs- und Schärfungsschritte vor dem Druck.

Die betroffene Person kennt ihr eigenes Gesicht besser als jeder andere. Dies ist vielleicht der menschlichste Aspekt im gesamten Prozess – und einer, der leicht übersehen wird, wenn man sich auf die technische Qualität des Ergebnisses konzentriert. Schon kleine Abweichungen vom tatsächlichen Aussehen einer Person können dazu führen, dass sich die KI-Version für die betroffene Person selbst subtil „falsch“ anfühlt, selbst wenn das Ergebnis für alle anderen vollkommen professionell wirkt. Eine leicht abweichende Kinnlinie, ein Auge, das geringfügig zu weit auseinander steht, eine Haut, die einen Hauch zu glatt ist – das sind Details, die Kollegen und Kunden niemals bemerken würden, die die Person auf dem Foto jedoch sofort spürt. Wir empfehlen, den Mitarbeiter immer in einen kurzen Freigabeschritt einzubeziehen und ihm die Möglichkeit zu geben, die Version auszuwählen, die seiner Meinung nach am besten zu ihm passt. Dies ist nicht nur eine bewährte Vorgehensweise für die Qualitätskontrolle, sondern auch eine Frage des Respekts. Das Bild wird seinen Namen und sein Gesicht auf Ihrer Plattform tragen; er sollte sich darin wohlfühlen und wiedererkannt werden.

Fazit: Das Wunder-Szenario ist nun in greifbarer Nähe

Das von uns angestrebte Szenario – ein neuer Mitarbeiter schickt ein Schnappschussfoto und erhält innerhalb weniger Minuten ein (meistens) professionelles, markengerechtes Porträt für die Website – ist keine Theorie mehr. Es funktioniert. Nicht jedes Mal perfekt und nicht schon bei der ersten Generation. Aber zuverlässig, wiederholbar und zu einem Bruchteil der Kosten und des Koordinationsaufwands herkömmlicher Fotografie.

Die Qualität der Ergebnisse ist sehr gut. Nano Banana skaliert das Eingabebild zudem hoch und sorgt für eine hohe Bildqualität. Unsere Testpersonen sagten mir jedoch, dass die Augen der schwierigste Teil seien – sie sind oft nicht sehr genau im Vergleich zu den echten Augen der Person.

Für wachsende Teams, Remote-First-Unternehmen oder jede Organisation, die schon einmal auf eine unpassende „Über uns“-Seite gestarrt und die stille Frustration über mangelnde Markenkonsistenz gespürt hat, ist dieser Ansatz nun in greifbarer Nähe.

Bei N47 sind wir darauf spezialisiert, die Lücke zwischen rohen KI-Fähigkeiten und echtem Geschäftswert zu schliessen. Wenn Sie vor derselben Herausforderung hinsichtlich visueller Konsistenz stehen und herausfinden möchten, wie eine massgeschneiderte ComfyUI-Pipeline für Ihre Marke aussehen könnte, helfen wir Ihnen gerne weiter.

→ Nehmen Sie mit uns Kontakt auf und lassen Sie uns gemeinsam Ihr digitales Studio aufbauen.