WWDC25 ist vorbei, und ich kann mit Zuversicht sagen, dass es eine der produktivsten Konferenzen der letzten Jahre war. Apple präsentierte eine beeindruckende Reihe von Ankündigungen für Entwickler: neue Frameworks, Module und unzählige Verbesserungen, die die Art und Weise prägen werden, wie wir Apps entwickeln.

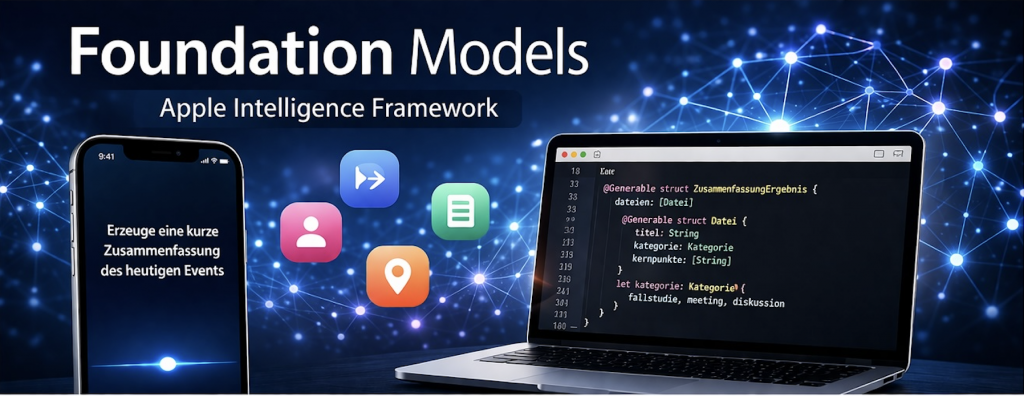

Unter all den spannenden Neuheiten hat eine bestimmte Neuerung meine Aufmerksamkeit besonders auf sich gezogen: das „Foundation Models“-Framework. Apple widmete diesem Thema mehrere Vorträge als auch praktische Anwendungsbeispiele.

Was ich mir vorgenommen habe

Als ich mit den Recherchen für diesen Beitrag begann, hatte ich mir ein ehrgeiziges Ziel gesetzt: eine praxisnahe Umsetzung mithilfe des neuen Frameworks zu erstellen und meine Erkenntnisse anhand praktischer Erfahrungen zu teilen. Allerdings bin ich auf einige derzeitige Einschränkungen gestossen, die mich daran hindern, dieses Live-Beispiel vorerst zu erstellen.

Ich werde diese Einschränkungen im Laufe des Beitrags erläutern, möchte Ihnen aber versichern, dass ein praxisorientierter, codeintensiver Folgebeitrag definitiv folgen wird. Lassen Sie uns zunächst einmal untersuchen, was Foundation Models so überzeugend macht und was dies für iOS-Entwickler bedeutet.

Was ist Foundation Models?

Was ist Foundation Models?

Foundation Models ist Apples neues Framework für die lokale Verarbeitung, das als Brücke zwischen Ihrer App und den Funktionen des grossen Sprachmodells von Apple Intelligence dient. Stellen Sie es sich als Kommunikationsschicht vor, die es Entwicklern ermöglicht, leistungsstarke KI-Funktionen direkt in ihren Anwendungen zu nutzen.

Wie Funktioniert Foundation Models?

Der Ablauf ist genial einfach: Ein Nutzer sendet eine Anfrage über Ihre App, und das geräteinterne Modell verarbeitet diese lokal, um intelligente Antworten zu generieren. Apple hat dieses Framework für bestimmte Aufgaben optimiert, die Entwickler häufig benötigen, darunter Zusammenfassungen, Entitätsextraktion, Textverständnis, Inhaltsverfeinerung, Dialoge in Spielen und kreatives Schreiben.

Strukturierter Output: Der Wegbereiter

Was Foundation Models von typischen KI-Integrationen unterscheidet, ist die Fähigkeit, strukturierte Daten statt blossem Text zurückzugeben. Anstelle einer rohen Zeichenfolgenantwort erhalten Sie strukturierte Ergebnisse – in der Regel als Dictionaries, mit denen Ihre App sofort arbeiten kann.

Die wahre Stärke liegt in der Steuerung der Ausgabe. Entwickler können mithilfe des Makros @Generable in iOS oder macOS genau definieren, was sie benötigen. Mit diesem Makro können Sie Datenstrukturen festlegen, die das Antwortformat des Modells bestimmen, sodass die KI-Ausgabe perfekt zu den Anforderungen Ihrer App passt.

Geräteanforderungen

Für die Nutzung von Foundation Models muss „Apple Intelligence“ auf Ihrem Gerät aktiviert sein. Derzeit ist die Kompatibilität daher auf bestimmte Geräte beschränkt: alle iPhone 16-Modelle, ausgewählte iPhone 15-Modelle, bestimmte iPad-Modelle sowie MacBooks mit M1-Chip oder neuer. Eine vollständige Kompatibilitätsliste finden Sie auf der Website von Apple.

Hauptmerkmale

- Multimodal: Versteht Text, Bilder und in manchen Fällen eine Kombination aus beidem.

- Vortrainiert und universell einsetzbar: Wurde bereits anhand grosser Datensätze trainiert, sodass Sie keine Daten selbst sammeln oder kennzeichnen müssen.

- On-Device & privat: Optimiert für die lokale Ausführung auf Apple Silicon (A17 Pro, M-Serie), wodurch eine datenschutzorientierte KI ohne Abhängigkeit von der Cloud gewährleistet wird.

- Verfügbar über neue Apple-APIs: Zugriff über Swift und Python (MLX) mithilfe von High-Level-APIs, die in Xcode 17 und macOS Sequoia (Tahoe Beta) eingeführt wurden.

✈️ Praxisbeispiel: Reiseplanung mit Grundmodellen

Eine der beeindruckendsten Demos auf der WWDC25 zeigte, wie Apples Foundation Models das Nutzererlebnis durch praktische Anwendungen im Alltag verbessern können. Während der Präsentation demonstrierte ein Referent einen Reiseplaner, der vollständig auf der im Gerät integrierten KI basiert.

Das Szenario? Eine bestehende iOS-App, die beliebte Sehenswürdigkeiten weltweit anzeigt, wurde durch die Leistungsfähigkeit der Foundation Models erweitert. Wählt man nun eine Sehenswürdigkeit in der App aus, wird ein dynamischer Reiseplan für diese bestimmte Sehenswürdigkeit generiert. All dies geschah ohne den Aufruf externer APIs oder Cloud-Dienste – ein Beweis für die Leistungsfähigkeit lokaler Intelligenz bei gleichzeitiger Wahrung der Privatsphäre der Nutzer.

💡 Stellen Sie sich vor, Sie entwickeln eine App, in der Nutzer auf einen Ort tippen und sofort einen intelligenten, KI-generierten Reiseplan oder Reiseführer erhalten – personalisiert, hilfreich und offline nutzbar.

Die Präsentation war in vier Teile gegliedert:

- Prompt-Engineering: Der Referent beschrieb, wie man mithilfe der Generable-Makros und der Guides für die Eigenschaften in der Prompt-Struktur einen hochwertigen Prompt erstellt.

- Tool-Aufruf: Es gibt ein spezielles Tool-Protokoll, das es Foundation Models ermöglicht, externe Informationen in ihre Antworten einzubeziehen. Hier können Entwickler kreativ werden und die Kontakte des Benutzers, Termine im Kalender sowie viele andere Optionen auf dem Smartphone als externe Datenquellen nutzen.

- Streaming-Ausgaben. In diesem Teil beschrieb der Referent die Vorteile des Streamings der Ausgabe, anstatt darauf zu warten, dass der gesamte Inhalt generiert wird. Glücklicherweise enthält das Foundation-Models-Framework ausgefeilte Methoden, um dies zu ermöglichen. Durch die Kombination des SwiftUI-Inhaltsübergangseffekts auf den Textlabels, der optionalen Verkettung in Swift und der partiellen Inhaltsgenerierung in Foundation Models erhalten wir einen leistungsstarken und benutzerfreundlichen Bildschirm für unseren Reiseplan.

- Profiling: Der letzte Teil der Präsentation diente dazu, einige Verbesserungsmöglichkeiten aufzuzeigen. In das System der Profiling-Tools von XCode wurde ein neues Profiling-Tool für Foundation Models hinzugefügt. Mit diesem Profiling-Tool kann der Benutzer die Leistung des KI-Modells untersuchen. Der Referent schlug einige Verbesserungsmöglichkeiten vor, wie beispielsweise das Vorwärmen der Sitzung, damit der Benutzer nicht warten muss, bis das Modell vorbereitet ist. Auch in einigen spezifischen Anwendungsfällen, in denen der Benutzer wiederholt ähnliche Eingabeaufforderungen stellt, könnte das Schema nicht in die Antwort einbezogen werden. Dies wird die Geschwindigkeit der App verbessern.

Limitierungen

Apple wirbt in seinen Präsentationen häufig mit der Verfügbarkeit des „Foundation Models“-Frameworks. Dabei wird jedes Mal betont, dass es auf iOS, macOS, VisionOS und watchOS verfügbar ist, doch in Wirklichkeit kommen nur das iPhone 16, einige iPhone 15 Pro-Modelle, die MacBooks mit M1-Chip sowie neuere MacBooks in den Genuss dieses Vorteils.

Ich bin pessimistisch, dass ältere Geräte eines Tages in der Lage sein werden, Foundation Models zu nutzen, aber die Zeit vergeht schnell und hoffentlich werden diese Modelle nur einen geringen Prozentsatz der Gesamtnutzung ausmachen.

🔮 Was dies für iOS-Entwickler in den nächsten 6 bis 12 Monaten bedeutet

Auch wenn Foundation Models für die meisten von uns noch nicht vollständig verfügbar sind (es sei denn, man nutzt macOS Sequoia auf dem neuesten Apple Silicon), markiert ihre Ankündigung einen deutlichen Wandel in Apples KI-Strategie: Intelligenz hält immer schneller Einzug in die Geräte.

Im nächsten Jahr können wir Folgendes erwarten:

🔹 Erweiterte APIs, die die Integration von Sprach- und Bildverarbeitungsaufgaben in iOS-Apps vereinfachen.

🔹 Engere Integration mit SwiftUI, Core ML und System-Frameworks wie Siri, Spotlight und Fotos.

🔹 Intelligentere Apps mit geringerem Backend-Overhead, insbesondere für Bereiche wie Inhaltszusammenfassungen, Empfehlungen und gerätebasierte Assistenten.

🔹 Ein wachsendes Ökosystem von für Apple optimierten KI-Tools, darunter Modellkonverter, MLX-Unterstützung und verbesserte Entwicklertools in Xcode.

Als Entwickler ist es jetzt an der Zeit, sich die relevanten WWDC25-Sessions anzusehen.

Ehrlich gesagt sind die Ankündigungen zu diesem Framework eine Art Revolution. Ich glaube, dass dies die statischen Apps verbessern wird, mit dynamischen Inhalten, die durch das gerätebasierte Wissen generiert werden, das von Apple Intelligence unterstützt wird.

Was kommt als nächstes?

Für die nächste Zeit ist geplant, die Möglichkeiten der Foundation-Modelle anhand eines konkreten Beispiels in einer massgeschneiderten iPhone-App zu testen. Wir informieren, wenn es so weit ist!